Von Dominic

Da ich aufgrund eines Unfalles nicht während der Produktion am Set helfen konnte, und meine Kernkompetenzen ohnehin im Bereich der Postproduktion liegen, möchte ich Euch in der heutigen Inspiration einen kleinen Einblick in den Workflow der Postproduktion geben.

Zwei BMCC waren über 12 Drehtage im Einsatz

Gedreht wurde mit zwei Blackmagic Cinema Cameras (sowie zusätzlich noch mit einer Blackmagic Pocket Cinema Camera). Auf der Formatseite hatten wir uns schnell für eine Aufnahme in DNxHD 185x und mit der logarithmischen Gammakurve entschlossen. Geschnitten wurde im Avid, dessen eigener Codec DNxHD ist, und so ein schnelles Einladen und gute Schnittperformance ermöglichte. Eine Raw-Aufnahme über 12 Drehtage hätte unsere Speicherkapazitäten und mein Editing Raid vermutlich an seine Grenzen gebracht. Außerdem sollte während des Schnittes alles in Online Qualität vorliegen und ein Arbeiten mit Proxys war nicht gewünscht. Dies ersparte mir zum späteren Zeitpunkt einen großen Teil des Conformings auf dem Weg in die Farbkorrektur und sorgte für bestmögliche Qualität während der Rohschnittzeit und den Abnahmen. Mit den Daten der 12 Drehtage machte ich mich dann ans Werk. Als mein eigener Schnittassistent galten meine ersten Tage, die noch während der Produktionszeit gearbeitet wurden, dem Anlegen, Gruppieren und sortieren der Drehmaterialien. Um das Sichten auf ein Minimum reduzieren zu können, arbeiteten wir schon am Set mit Hilfe von Cutterberichten, die mir im Schnitt alle Takes mit dem besten Spiel nannten und ich so schnell ins Schneiden übergehen konnte. Während der Schnittzeit ruhten alle Daten dabei mehrfach gesichert auf meinem Schnittplatz. Die Avid Media Files waren auf meinem gespiegeltem Raid untergebracht. Im Falle des Supergaus, dass zwei Festplatten gleichzeitig abschmieren sollten, hatte ich alles Rohmaterial im nativen Format auch noch auf einer Festplatte, um zur Not alles nachbatchen zu können. Und sollte dieser Festplatte etwas zustoßen, lag bei Martin ein Spiegel dieser Rohmaterial-Platte. Das Projekt war also sicher.

Der eigentlich Schnitt war dann eigentlich recht simpel. Alle Handlungen waren über Kennungen eingeteilt, um auch die Interaktivität einfach einordnen zu können und um eine Grundlage der Diskussion zu haben. Diese einzelnen Bilder waren dann in Avid Bins geordnet. Geschnitten wurden dann alle möglichen Interaktivitäts-Möglichkeiten, jeweils in separaten Sequenzen, die nach Datum sortiert vorlagen und so jederzeit zur Version des Vortags zurückgekehrt werden konnte. Da ich nur während der Produktionszeit Urlaub von meinem eigentlichen Job hatte, wurde die Schnittzeit in Nachtschichten absolviert, was den späten Release der Folgen größtenteils erklärt.

Nachdem die Folgen durch die Rohschnittabnahmen und den Feinschnitt durch waren, ging ein AAF Export mit allen Tonfiles, sowie ein Ansichts-Quicktime an Ben und in die Mischung. Ich machte mich zeitgleich an die Farbkorrektur.

Davinci Resolve 11 – für die 12 hatte ich noch keine Zeit

Die Korrektur erfolgte dabei im Davinci Resolve. Größtenteils, weil es aktuell das beste Preis-Leistungsverhältnis darstellt, das auf dem Markt zu finden ist. Auch wenn es nicht meine erste Wahl der Gradingsoftware darstellt, so hat es mir doch schon gute Dienste geleistet. Das Conforming war in wenigen Stunden erledigt – Resolve konnte sich, dank Online Workflow, direkt auf die Avid Mediafiles verlinken, sodass nur eine AAF vom Schnitt nötig war, um alle Materialien online zu haben.

Da ich in meinem Job quasi täglich die Korrektur von Serien auf meinem Tisch liegen habe, war ich es gewöhnt schnell und zügig zu korrigieren.

Tangent Wave Panel

Mein bester Freund das Tangent Wave half mir dabei ungemein. Würde ich mir vorstellen, dass ich alle Korrektur mit der Maus und somit eins nach dem anderen korigieren müsste, so würde ich vermutlich heute noch an der Korrektur sitzen.

Breaking News stellt dabei ein verhältnismäßig “kleines” Projekt dar – was das Grading betrifft. Wo ich in meiner Firma pro Tag irgendetwas zwischen 400 und 600 Schnitte Material korrigieren muss, das sich auch noch aus verschiedenen Kameras zusammensetzt, bat mir Breaking News eine handvoll Sets mit gleichen Kameratypen und knapp 150 Schnitten pro Episode. Child’s Play.

Nichtsdestotrotz wollte ich einen Workflow fahren, der es mir ermöglich schnell und einfach Grades zu kopieren, einfach später kleinere Korrekturen zu erledigen und mich niemals vor das typische “Was hab ich denn in dem Node jetzt eigentlich gemacht”-Wundern zu stellen, wenn ich Tage später zurück an das Projekt gehen sollte.

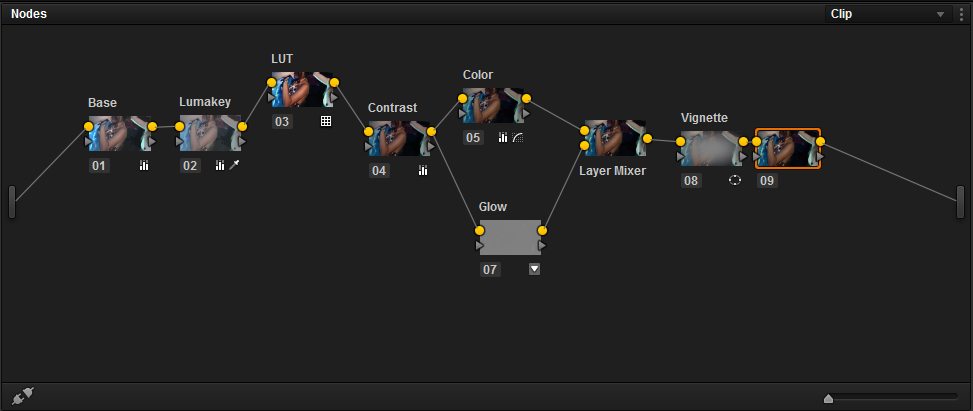

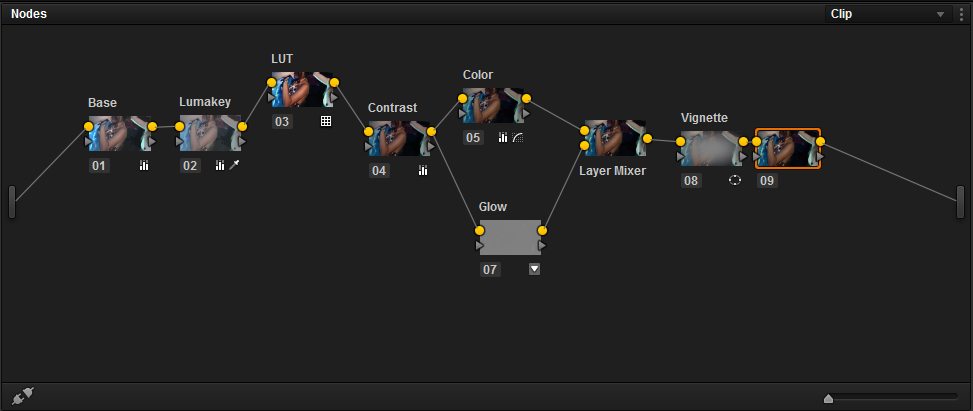

Der klassische Node-Aufbau sah demnach für jeden Schnitt identisch aus und wurde nur in Spezialfällen erweitert.

Mein Standard Node Tree, der auf allen Einstellungen lag

Base: mein Baselayer (dessen Benennung aus dem Nucoda Filmmaster übernommen wurde) galt nur der Korrektur vor dem Look Up Table, und sollte jedes Clipping verhindern und für richtige Pegel sorgen.

Lumakey: Node zwei war mit einem soften Lumakey versehen und stellte eine Möglichkeit der Kompression von Schwärzen, oder Highlights dar, falls benötigt. Alles noch vor dem Lut, der die Wandlung von Log zu Lin als Aufgabe hatte. Dies ist ein toller Trick um 13 Blenden Log Material in 9 Blenden-Dynamik des Ausgabefarbraums zu pressen.

Contrast und Color: Der erste Node nach dem LUT war ausschließlich für die Korrektur der Luminanz vorgesehen, und der Color Node ausschließlich für die der Farben. Die Trennung in zwei Nodes ermöglichte es mir, nur die Luminanz-, oder Farbkorrektur zwischen Schnitten zu kopieren und leichte Vergleiche des Vorher/Nachher zu kontrollieren.

Glow: Abgerundet wurde mein Basis-Setup durch einen Layermixer, der über einen Highlight-Key einen Glow-Effekt auf das Bild legen konnte. Dieser wurde einfach über die Transparenz des Nodes nach belieben eingestellt.

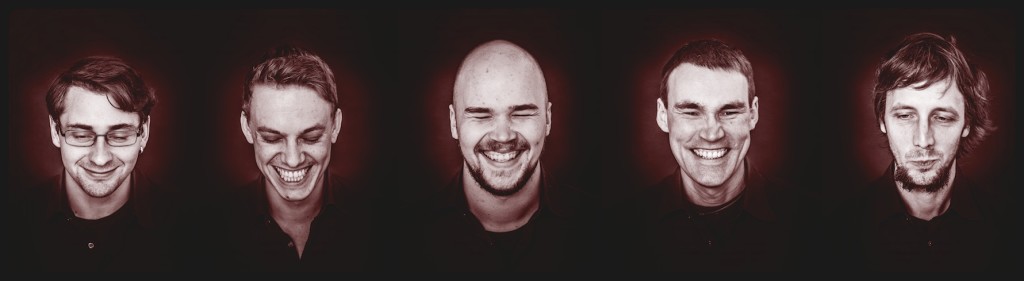

Einstellung aus dem Ramboapproach der dritten Episode

Vignette: Meine Basis Vignette fand sich auf dem letzten Node vor und wurde bei Bedarf eingestellt, oder im Standard-Setup verwendet.

Pan and Scan / Blanking: Die Positionsänderungen und die Letterbox-Balken für den Widescreen-Look kamen zum Schluss.

Im Großen und Ganzen konnte ich so in 30-40 Sekunden ein neues Bild korrigieren – sodass ich mit den Folgen in 1-2 Tagen durch war. Nur um dann natürlich wieder von vorne zu beginnen. Immerhin war dies keine meiner Serien, mit denen ich es auf Arbeit zu tun habe und die immer gleich aussehen sollen, und die Projete dementsprechend weniger komplex sind. Im zweiten Durchgang setzte ich deutlich mehr Masken, nahm mir mehr Zeit für jedes Bild, zog Keys und versuchte aus jedem Bild das beste rauszuholen.

Besonders die Verwendung von Filmprint Emulations LUTs kann hervorgehoben werden, wenn Fragen nach dem Look auftauchen sollten. Wohingegen die technisch korrekten LUTs vom Blackmagic Farbraum in den HD Standard Rec 709 wandeln, haben sie doch nicht den Charm von echtem Filmmaterial.

Christin mit Korrektur über den Standard LUT

Christin mit Korrektur über Filmprint LUT

Wohingegen die Standard LUTs einen sehr “videohaften” Look haben und übersättigt wirken, wissen die Filmstocks, wie Hauttöne am besten zur Geltung kommen und welche Gradation dem Ausbelichten auf Film am nähsten kommen.

oben: Log-Material unkorrigiert; links: Lut und Luminanzkorrektur; rechts: fertiges Grading

Die restliche Korrektur versuchte danach alles dem Hautton unterzuordnen. Die erste Korrektur galt immer dem Hautton, die folgendem den neutralen Extremen Schwarz und Weiß, und die letzten dann den Orten des Bildes die Korrekturen bedarfen.

Am Ende der Farbkorrektur galt es nur noch kleine VFX-Shots, wie Schüsse und Retuschen durchzuführen, alles zusammenzubauen und auf die Ergebnisse der Umfrage zu warten.

Falls Fragen zu gewissen Einstellungen, der Farbkorrektur, der Effekte, oder des Schnittes gibt, so schreibt uns auf Facebook, oder hier über die Homepage eine Nachricht. Ich bin gerne bereit tieferen Einblick zu gewähren und Dinge zu erklären. Immer her mit den Fragen!

Grüße,

Dominic

Ich weiß nicht, ob dieser Remix mit der kommunikativen Kastration von twitter Einzug fand, jedoch zeigt sich im technisch gestützten Umgang zwischen Menschen die Notwendigkeit zur Beschränkung. Kritiker könnten meinen, die Beschränkung besteht hauptsächlich durch mentale Barrieren meinerseits, jedoch kommt keiner drumherum, die Eindampfung unseres kommunikativen Arsenals zu erkennen. Hashtags nehmen gesamte Sinneinheiten und Aussagen ab, Zeichengrenzen pressen jeden Gedanken in ein fast schon dadaistisches Gewand. Schrecken Teenager bei

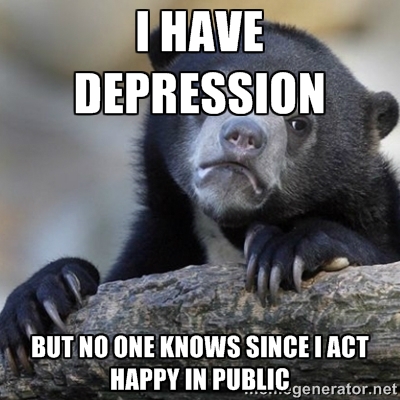

Ich weiß nicht, ob dieser Remix mit der kommunikativen Kastration von twitter Einzug fand, jedoch zeigt sich im technisch gestützten Umgang zwischen Menschen die Notwendigkeit zur Beschränkung. Kritiker könnten meinen, die Beschränkung besteht hauptsächlich durch mentale Barrieren meinerseits, jedoch kommt keiner drumherum, die Eindampfung unseres kommunikativen Arsenals zu erkennen. Hashtags nehmen gesamte Sinneinheiten und Aussagen ab, Zeichengrenzen pressen jeden Gedanken in ein fast schon dadaistisches Gewand. Schrecken Teenager bei  nicht aus dem engen Flaschenhals, sondern werden Kübelweise ausgeschüttet. Deal with it. Da kommt es nicht von ungefähr, dass komplette emotionale Befindlichkeiten empathisch globalzugänglich zu machen, indem man ein einziges Bild verwendet. Damit reicht ein Malaiischer Bär mit hängenden Mundminkeln aus, um Symptome einer depressiven Phase mit der ganzen Welt zu teilen. Und so steigt jeder auf die Zeichensprache ein. Kommunikatives Meme-ikri sozusagen.

nicht aus dem engen Flaschenhals, sondern werden Kübelweise ausgeschüttet. Deal with it. Da kommt es nicht von ungefähr, dass komplette emotionale Befindlichkeiten empathisch globalzugänglich zu machen, indem man ein einziges Bild verwendet. Damit reicht ein Malaiischer Bär mit hängenden Mundminkeln aus, um Symptome einer depressiven Phase mit der ganzen Welt zu teilen. Und so steigt jeder auf die Zeichensprache ein. Kommunikatives Meme-ikri sozusagen.

ichkeit der Bildstabilisation bieten soll. Das Projekt nennt sich SteadXP – The Future of Video Stabilization . Es handelt sich um ein kleines Modul voller Elektronik und Sensorik, das direkt an der Kamera appliziert werden kann. Bei Spiegelreflexkameras erfolgt dies über die Aufnahme für Aufsteckblitze. Auch eine Version für die GoPro Hero Reihe soll erhältlich sein. Bei der Actionkamera kann das Modul einfach auf die Rückseite geklickt werden, wo sonst Zusatzakkus ihren Platz finden.

ichkeit der Bildstabilisation bieten soll. Das Projekt nennt sich SteadXP – The Future of Video Stabilization . Es handelt sich um ein kleines Modul voller Elektronik und Sensorik, das direkt an der Kamera appliziert werden kann. Bei Spiegelreflexkameras erfolgt dies über die Aufnahme für Aufsteckblitze. Auch eine Version für die GoPro Hero Reihe soll erhältlich sein. Bei der Actionkamera kann das Modul einfach auf die Rückseite geklickt werden, wo sonst Zusatzakkus ihren Platz finden.

hat, um den Spieler ein letztes Mal vor die qualvolle Wahl zu stellen, langsam kriechend oder brutal ballernd die Burg zu infiltrieren. Aufmerksame „Inspirationsleser“ werden nun ahnen, dass ich hier wieder in Kindheitserinnerungen verfalle und ja – sie haben recht. Da Metal Gear Solid jedoch ein Stück weit Videospielgeschichte ist und nun vollendet wurde, wäre es wohl stark fahrlässig, hierbei nicht die vergilbten Seiten seiner eigenen Biographie aufzuschlagen, um klar zu machen, welche Bedeutung, welche Inspiration die Reihe für mich hat.

hat, um den Spieler ein letztes Mal vor die qualvolle Wahl zu stellen, langsam kriechend oder brutal ballernd die Burg zu infiltrieren. Aufmerksame „Inspirationsleser“ werden nun ahnen, dass ich hier wieder in Kindheitserinnerungen verfalle und ja – sie haben recht. Da Metal Gear Solid jedoch ein Stück weit Videospielgeschichte ist und nun vollendet wurde, wäre es wohl stark fahrlässig, hierbei nicht die vergilbten Seiten seiner eigenen Biographie aufzuschlagen, um klar zu machen, welche Bedeutung, welche Inspiration die Reihe für mich hat. Wer die Spielreihe kennt, wird wissen, dass Kojima bei seinem ersten Gehversuch auf den Polygonplanken der Playstation diesen überschaubaren Plot mit vielen Twists, Verschwörungstheorien und der Prise an östlicher Fiktion und Überzeichnung aufbauscht und damit unwiderstehlich macht. In Zeiten, in denen Videospiele in der Masse maximal als Alltagsintermezzo mit zwei Buttons verstanden wurde, kreierte die erste populäre Version eines Action-Stealth-Spiels jedoch etwas Neues, etwas Großes. Metal Gear bestand dadurch zwar zu 60% aus Dialogen, die aufgrund der begrenzten Möglichkeiten einer CD-ROM überwiegend als Hörspiel in einem statischen Codec-Interface daherkamen, aber der Spieler, ich, war dennoch gefesselt. Als ich auf dem Boden lag und den Artikel wälzte, mit dem schmerzlichen Gefühl, die beiliegende Demo erst Tage später zu Hause zocken zu können, war mir die narrative Komplexität von MGS natürlich gleich. Vielmehr konnte ich es nicht glauben, was die Redakteure über die Spielmechanik zu berichten hatten – angeblich bot das Spiel damit eine neue und intelligente Reaktion auf die Aktionen des Spielers. Gegner hören Geräusche und gehen diesen nach, erkennen Fußabdrücke im Schnee, können gelockt und lautlos gemeuchelt werden. Snake bewegt sich kriechend durch Lüftungsschächte, versteckt sich in Kisten, entdeckt durch den Rauch der Zigarette Sensoren, sprengt geheime Gänge mittels

Wer die Spielreihe kennt, wird wissen, dass Kojima bei seinem ersten Gehversuch auf den Polygonplanken der Playstation diesen überschaubaren Plot mit vielen Twists, Verschwörungstheorien und der Prise an östlicher Fiktion und Überzeichnung aufbauscht und damit unwiderstehlich macht. In Zeiten, in denen Videospiele in der Masse maximal als Alltagsintermezzo mit zwei Buttons verstanden wurde, kreierte die erste populäre Version eines Action-Stealth-Spiels jedoch etwas Neues, etwas Großes. Metal Gear bestand dadurch zwar zu 60% aus Dialogen, die aufgrund der begrenzten Möglichkeiten einer CD-ROM überwiegend als Hörspiel in einem statischen Codec-Interface daherkamen, aber der Spieler, ich, war dennoch gefesselt. Als ich auf dem Boden lag und den Artikel wälzte, mit dem schmerzlichen Gefühl, die beiliegende Demo erst Tage später zu Hause zocken zu können, war mir die narrative Komplexität von MGS natürlich gleich. Vielmehr konnte ich es nicht glauben, was die Redakteure über die Spielmechanik zu berichten hatten – angeblich bot das Spiel damit eine neue und intelligente Reaktion auf die Aktionen des Spielers. Gegner hören Geräusche und gehen diesen nach, erkennen Fußabdrücke im Schnee, können gelockt und lautlos gemeuchelt werden. Snake bewegt sich kriechend durch Lüftungsschächte, versteckt sich in Kisten, entdeckt durch den Rauch der Zigarette Sensoren, sprengt geheime Gänge mittels  C4 frei, nachdem er via Abklopfen strukturelle Schwachstellen entdeckte – eine Bandbreite an Gameplay, das das Wort tatsächlich verdient hatte. Bis zu diesem Zeitpunkt kannte ich diese handwerkliche Spieltiefe nicht – die Welt reagiert auf mich, auf mein Handeln und ich kann Dinge ausprobieren, die ich für logisch hielt – und siehe da, es funktioniert. Metal Gear schaffte etwas Eigenes: es ließ mich zum ersten Mal ein Spiel auf meine eigene Weise angehen. Neben den unzähligen „Metal Gear“-Momenten, die mehrere Generationen als kollektive Erfahrung teilen und auch über ein Jahrzehnt später gemeinsam schwelgen und staunen lassen, übergab Kojima das Pad in die Hand des Spielers, freundlich lächelnd mit der Empfehlung: „Und jetzt mach was draus!“. Wenn wir über die Sandboxfreiheiten eines Grand Theft Auto sprechen, so dürfen wir nicht vergessen, dass Metal Gear Solid uns als eines der ersten Spiele überhaupt die Freiheit der spielerischen Exploration einer Welt überließ. Natürlich mit dem Folgeeffekt, dass jeder MGS-Gamer meint, seine Herangehensweise wäre die einzig Richtige.

C4 frei, nachdem er via Abklopfen strukturelle Schwachstellen entdeckte – eine Bandbreite an Gameplay, das das Wort tatsächlich verdient hatte. Bis zu diesem Zeitpunkt kannte ich diese handwerkliche Spieltiefe nicht – die Welt reagiert auf mich, auf mein Handeln und ich kann Dinge ausprobieren, die ich für logisch hielt – und siehe da, es funktioniert. Metal Gear schaffte etwas Eigenes: es ließ mich zum ersten Mal ein Spiel auf meine eigene Weise angehen. Neben den unzähligen „Metal Gear“-Momenten, die mehrere Generationen als kollektive Erfahrung teilen und auch über ein Jahrzehnt später gemeinsam schwelgen und staunen lassen, übergab Kojima das Pad in die Hand des Spielers, freundlich lächelnd mit der Empfehlung: „Und jetzt mach was draus!“. Wenn wir über die Sandboxfreiheiten eines Grand Theft Auto sprechen, so dürfen wir nicht vergessen, dass Metal Gear Solid uns als eines der ersten Spiele überhaupt die Freiheit der spielerischen Exploration einer Welt überließ. Natürlich mit dem Folgeeffekt, dass jeder MGS-Gamer meint, seine Herangehensweise wäre die einzig Richtige.

Während wir uns in die Welten der Filmproduktion begeben, hat der Musiker Görkem Sen eine Möglichkeit geschaffen, eine besondere auditive Entführung zu gestalten. Mit der Yaybahar baute er ein akustisches Instrument, dass jedoch sehr synthetisch wirkende Klänge erzeugt. Damit kreiert er eine sehr abgefahrene Soundkulisse, die an Künstler wie

Während wir uns in die Welten der Filmproduktion begeben, hat der Musiker Görkem Sen eine Möglichkeit geschaffen, eine besondere auditive Entführung zu gestalten. Mit der Yaybahar baute er ein akustisches Instrument, dass jedoch sehr synthetisch wirkende Klänge erzeugt. Damit kreiert er eine sehr abgefahrene Soundkulisse, die an Künstler wie

ierung wurde in anderen Formaten bereits ausführlich diskutiert, sodass ich an dieser Stelle nicht Fässer öffnen will, deren Inhalt wir bereits zum Frühstück, Mittagessen und Abendbrot hatten. Es sei nur darauf hingewiesen, wie sehr er unseren Alltag beeinflusst. Jumpcuts definieren unsere neue Art der many-to-many Kommunikation, verändern vielleicht sogar kognitive Fähigkeiten von heranwachsenden Konsumenten. Gesprächskultur und Gesprächshygiene wird beschnitten und zu einer Form von Informations-Tiki Taka eingedampft. Die katalanische Version von form follows function. Doch übt man hier vielleicht Kritik an der Art und Weise, wie Nutzer Inhalte genierieren, so bleibt im Abtropfsieb dieser Diskussion zumindest der Erkenntnisrückstand hängen, dass sie es tun. Der Mensch als reflektives Wesen lässt in einer Form des schnellverdaulichen Enterntainment seine Umwelt in die eigene Gedankenwelt einblicken. Auch wenn diese Welt manchmal nur den Umfang eine Juniortüte hat. Convenience-Unterhaltung in Zeiten der Zeitverdichtung sozusagen. Und alles im Zuge der gesteigerten Aufmerksamkeitslenkung. Der Mensch hat bedienbare Werkzeuge, um kurzfristig einen Schritt näher in den Mittelpunkt der Öffentlichkeit zu rücken und denkt damit automatisch konstant über die Dinge nach, die er mit dem Volk teilen will. Ich streame, also bin ich.

ierung wurde in anderen Formaten bereits ausführlich diskutiert, sodass ich an dieser Stelle nicht Fässer öffnen will, deren Inhalt wir bereits zum Frühstück, Mittagessen und Abendbrot hatten. Es sei nur darauf hingewiesen, wie sehr er unseren Alltag beeinflusst. Jumpcuts definieren unsere neue Art der many-to-many Kommunikation, verändern vielleicht sogar kognitive Fähigkeiten von heranwachsenden Konsumenten. Gesprächskultur und Gesprächshygiene wird beschnitten und zu einer Form von Informations-Tiki Taka eingedampft. Die katalanische Version von form follows function. Doch übt man hier vielleicht Kritik an der Art und Weise, wie Nutzer Inhalte genierieren, so bleibt im Abtropfsieb dieser Diskussion zumindest der Erkenntnisrückstand hängen, dass sie es tun. Der Mensch als reflektives Wesen lässt in einer Form des schnellverdaulichen Enterntainment seine Umwelt in die eigene Gedankenwelt einblicken. Auch wenn diese Welt manchmal nur den Umfang eine Juniortüte hat. Convenience-Unterhaltung in Zeiten der Zeitverdichtung sozusagen. Und alles im Zuge der gesteigerten Aufmerksamkeitslenkung. Der Mensch hat bedienbare Werkzeuge, um kurzfristig einen Schritt näher in den Mittelpunkt der Öffentlichkeit zu rücken und denkt damit automatisch konstant über die Dinge nach, die er mit dem Volk teilen will. Ich streame, also bin ich. nden Zuwachs an Streamern, die ihr Scheitern, Schimpfen, ihre Freude und epische Siege in digitalen Welten zur Schau stellen wollen. Dienste, wie

nden Zuwachs an Streamern, die ihr Scheitern, Schimpfen, ihre Freude und epische Siege in digitalen Welten zur Schau stellen wollen. Dienste, wie